ML4Safety – Absicherung von Machine-Learning-Algorithmen für sicherheitskritische Funktionen

In Kürze

In Zusammenarbeit mit den Fraunhofer-Instituten IKS, ITWM und IOSB wird in diesem Fraunhofer-internen Projekt »PREPARE« ein ganzheitliches Framework zur Verifikation von »safeML« entwickelt, um den Einsatz innovativer Machine-Learning-Verfahren in sicherheitsrelevanten Anwendungen zu ermöglichen. Hersteller autonomer, safety-kritischer cyber-physischer Systeme, ihre Lieferanten sowie zuständige Prüf- und Zulassungseinrichtungen sollen dadurch unterstützt werden, ML-basierte Systeme auf den Markt zu bringen, die ein vergleichbares Maß an Sicherheit wie bisherige softwarebasierte Ansätze aufweisen.

Im Detail

Tiefe neuronale Netze und andere Methoden des maschinellen Lernens (ML) ermöglichen, hochkomplexe Zusammenhänge datengestützt zu modellieren, und gewähren so ein höheres Maß an Autonomie in cyber-physischen Systemen. Bedenken hinsichtlich der Zuverlässigkeit und der Robustheit von ML-Modellen, die eingeschränkte Erklärbarkeit der Entscheidungsfindung und das Fehlen aussagekräftiger Sicherheitsmetriken verhindern jedoch bisher deren breiten Einsatz in sicherheitsrelevanten Applikationen. Konkret ergeben sich hier zwei wesentliche Herausforderungen:

1) ML für sicherheitskritische Anwendungen in begrenztem Einsatzbereich: Aktuelle ML-Methoden erreichen noch nicht die für sicherheitskritische Software notwendigen geringen Fehlerraten. Es fehlen geeignete Standards und Entwicklungsmethoden, um das verbleibende Risiko und den Safety-relevanten Fehler im Zusammenhang mit ML-Komponenten nachzuweisen. Ein Beispiel sind stationäre Anwendung wie Cobots.

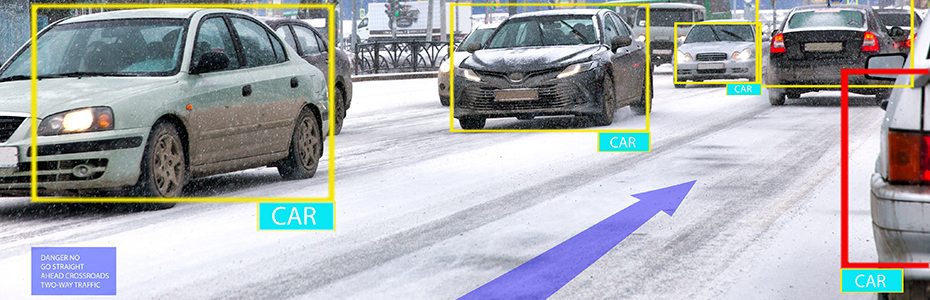

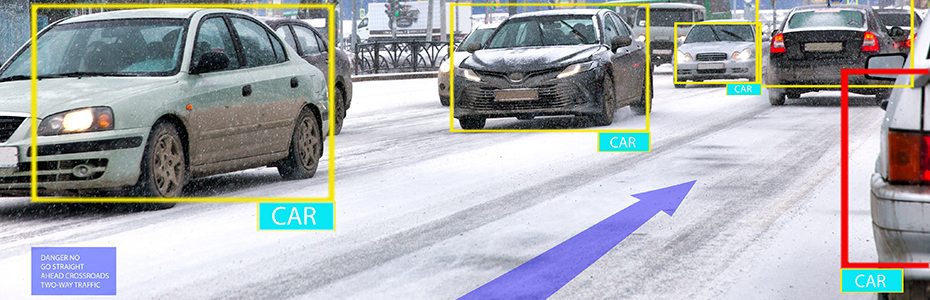

2) ML für sicherheitskritische Anwendungen ohne Begrenzungen: Systemseitige Ausgleichmaßnahmen und Nutzungseinschränkungen, die aufgrund der Fehlerraten von ML-Funktionen angewendet werden müssen, verursachen unerschwingliche Kosten oder schränken die Verfügbarkeit der entsprechenden Funktion ein. Die ML-Methoden müssen deshalb hinsichtlich domänenspezifischer Akzeptanzkriterien optimiert und quantitativ nachgewiesen werden. Ein automatisierter, iterativer Ansatz ist notwendig, um Anpassungen in Funktion und zulässigem Einsatzbereich zu unterstützen sowie die Entwicklungskosten zu reduzieren. Ein Beispiel sind mobile Anwendungen, beispielsweise autonome Fahrzeuge.

Damit die Industrialisierung von ML-Verfahren in Zukunft auch in den Domänen autonome Fahrzeuge, Baumaschinen und Cobots ihr enormes Wachstumspotenzial ausschöpfen kann, fokussiert sich das Projekt auf die folgenden Innovationen:

1) Demonstration der grundsätzlichen Eignung von ML-Techniken zur Erfüllung sicherheitskritischer Anforderungen in den gewählten Anwendungsdomänen.

2) Demonstration, wie die Wahrscheinlichkeit von verbleibenden sicherheitsrelevanten Ausfällen durch Kombination von komplementären Entwurfsmethoden, Analysetechniken, simulationsbasierten Prüfungen und Laufzeitmechanismen minimiert werden kann.

3) Nachweis, dass ein gleichwertiges Vertrauensniveau in ML-Modelle in cyber-physischen Systemen erreicht werden kann, wie dies bereits heute bei vorhandener sicherheitskritischer Software der Fall ist.