Radar-Technologie für intelligente Überwachung und Umgebungserfassung

Reiternavigation

Kompetenzen

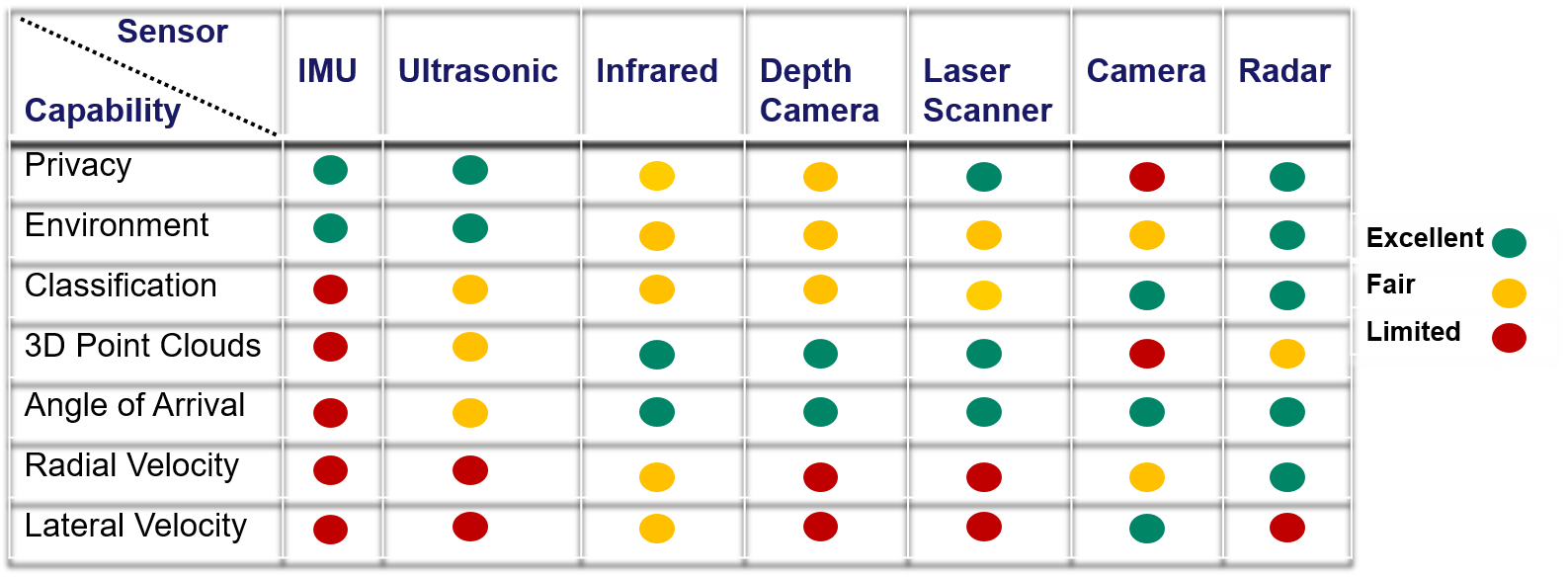

Radar ist eine attraktive Sensortechnologie für menschenbezogene Anwendungen dank seiner Fähigkeit, menschliche Bewegungen in Echtzeit unter Wahrung der Privatsphäre zu erfassen und dies auch bei Umgebungs- und/oder Lichtbedingungen, die für kamerabasierte Sensoren herausfordernd sind, wie zum Beispiel Rauch, Staub, bei Dunkelheit oder direkter Sonneneinstrahlung. Die Radartechnik ist insbesondere gut geeignet, um die sogenannten Mikrobewegungen der menschlichen Fortbewegung oder Vitalfunktionen zu erfassen, wie Bewegungen der Gliedmaßen beim Gehen und Brustbewegungen beim Atmen. Dadurch wird diese Technik für viele Anwendungen in den Bereichen »Intelligente Überwachung« und im Gesundheitswesen verwendet.

Unter Anwendung der jüngsten Entwicklungen bei der Herstellung von Radarsensoren in Bezug auf Verarbeitungsleistung, Echtzeitleistung und Größeneffizienz hat unser Team die Machbarkeit der Integration von Radarsensoren und deren Einsatz für die intelligente Überwachung und/oder Umgebungserfassung in verschiedenen realen Szenarien (an öffentlichen Orten, im industriellen Kontext sowie für Anwendungen im Gesundheitswesen) untersucht. In vielen Fällen werden klassische Radarverarbeitungsansätze durch Techniken des maschinellen Lernens ergänzt, die den hochgradig beschreibenden Inhalt des Sensorsignals nutzen. Bei Bedarf wurde der Radarsensor zusammen mit anderen Sensortechnologien in ein multimodales Wahrnehmungssystem integriert.

Was wir anbieten:

- Machbarkeitsstudien in Anwendungsszenarien, die menschliche Interaktion erfordern.

- Beratung bei der Auswahl und Anpassung der Radarhardware, basierend auf den Anwendungsbeschränkungen.

- Professionelle Labortests zur Problembewertung, die gemeinsam mit unseren Experten für die menschliche Fortbewegung durchgeführt werden.

Entsprechende Projekte

Covid-19 Access Checker

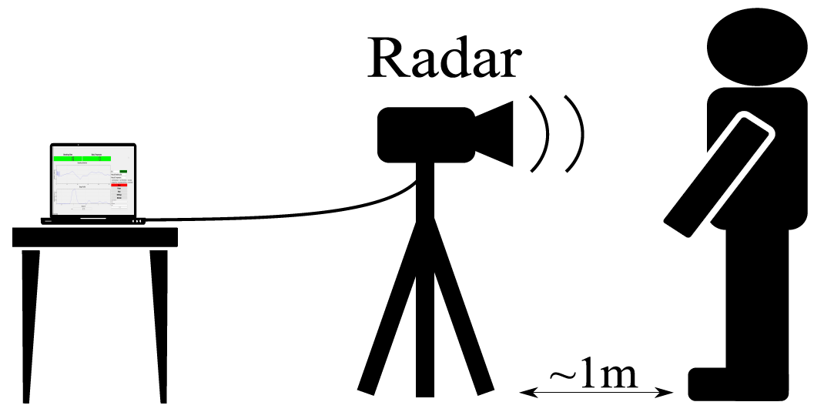

Abb. 2: Radarbasierte Lösung zur berührungslosen Erfassung der Atemfrequenz im Stehen

Abb. 2: Radarbasierte Lösung zur berührungslosen Erfassung der Atemfrequenz im StehenDie Fähigkeit des Radars, Mikrobewegungen des Körpers zu erfassen, kann genutzt werden, um die Bewegungen des Brustkorbs aus der Ferne zu erfassen. Dies ermöglicht die Messung von Vitaldaten (wie Atem- und Herzfrequenz) in Echtzeit und ohne Kontakt mit der Person. In diesem Zusammenhang haben wir für das spanische Unternehmen ITURRI einen Algorithmus entwickelt, um die Mikrobewegungen des Brustkorbs aus dem Radarsignal zu extrahieren und die Atemfrequenz zu messen, während die Person in einem Abstand von 1 bis 2 m vom Radar steht. Der Radarsensor wurde mit einer Wärmekamera kombiniert, um zusätzlich die Körpertemperatur aus zu messen. Mit diesem multimodalen Sensorsystem, dem so genannten Access Checker, können kritische Vitalparameter von Besuchern berührungslos gemessen werden, bevor ihnen der Zutritt zu öffentlichen Orten wie Flughäfen oder Krankenhäusern gewährt wird.

Intelligente Umgebungserkennung für adaptive Prothesen

Die Fähigkeit von Radarsensoren, die Entfernung von Zielen im Sichtfeld des Sensors zu erkennen, wurde bisher in zahlreichen Anwendungen (z. B. beim autonomen Fahren) genutzt, die eine Dimensionierung der Ziele erfordern. Mit Hilfe der Abtastfähigkeit von MIMO-Radarsensoren (Multiple-input multiple-output) können die Positionen mehrerer Ziele in einer Ebene in Echtzeit verfolgt werden. Durch die Montage des Radarsensors auf einer mobilen Plattform kann diese Fähigkeit beispielsweise genutzt werden, um eine zweidimensionale Karte der Ziele in der Sagittalebene zu erstellen, aus der die Dimensionen statischer Objekte, wie z. B. Treppen, extrahiert werden können. Mit diesem Ansatz haben wir ein Wahrnehmungssystem mit einem MIMO-Radar und einer IMU entwickelt, das potenziell in jedes mobile Robotersystem integriert werden kann, um Objekte in der Sagittalebene zu scannen und zu kartieren. Eine mögliche Anwendung liegt im Bereich der intelligenten Umgebungserfassung für adaptive Beinprothesen, um das automatische Überqueren von Hindernissen zu unterstützen. In diesem Zusammenhang haben wir einen rechnerisch effizienten Echtzeit-Ansatz für die Dimensionierung von Treppen entwickelt und validiert. Unsere Ergebnisse wurden auf der EUSIPCO2021 vorgestellt.

Zur sicheren Mensch-Roboter-Kollaboration

Verschiedene sich bewegende Ziele werden vom Radar mit eindeutigen Signaturen sowohl in Bezug auf die Geschwindigkeit als auch auf die Entfernung erfasst. Diese können in intelligenten Überwachungsanwendungen verwendet werden, bei denen die Fähigkeit, menschliche Ziele von anderen beweglichen Zielen zu unterscheiden, erforderlich ist, z. B. für eine sichere Mensch-Roboter-Kollaboration. Auf der Grundlage dieser Idee haben wir eine Technik entwickelt, die auf einem flachen neuronalen Netz basiert, das in der Lage ist, Menschen von sich bewegenden Robotern zu unterscheiden, um die Anwesenheit von Menschen in einem bestimmten Gebiet zu überwachen. Dieser Ansatz kann beispielsweise zur Überwachung von Sicherheitsbereichen um einen stationären Roboter verwendet werden, der sein Verhalten bei Anwesenheit eines menschlichen Nutzers anpassen muss, nicht aber bei einem sich nähernden FTS. Unsere Ergebnisse wurden 2018 auf der IEEE Radar Conference (RadarConf'18) veröffentlicht.

Personenidentifikation

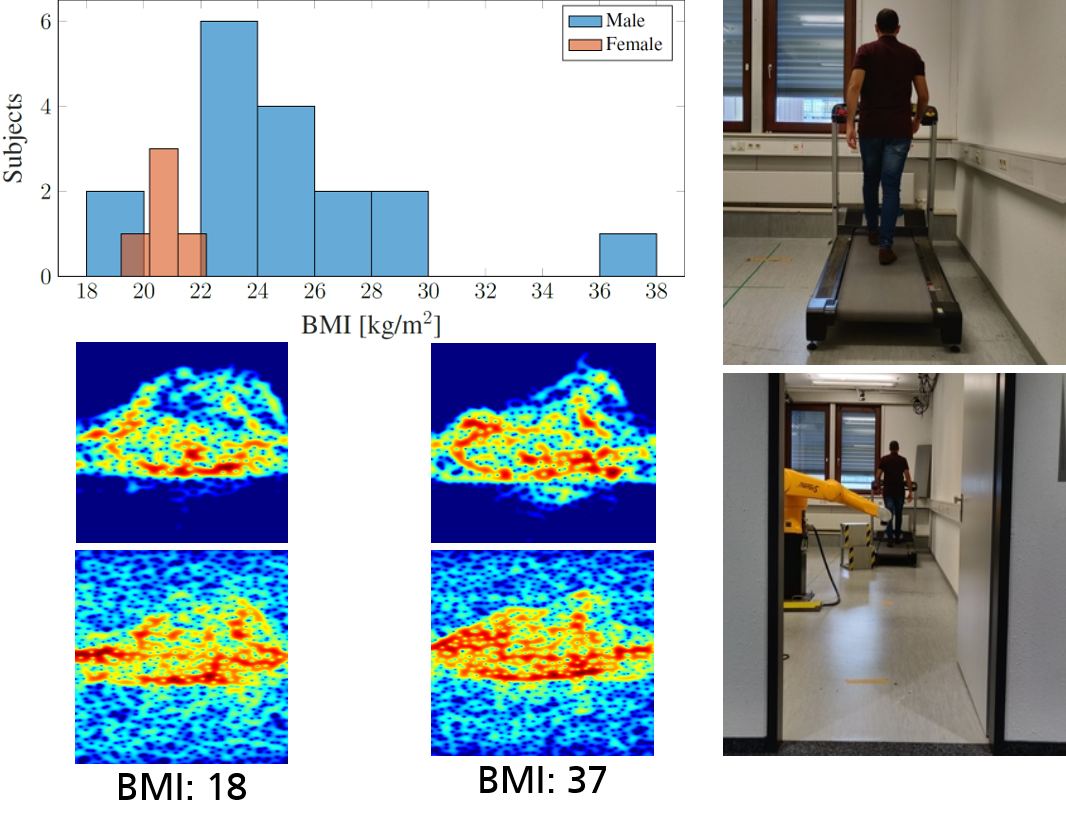

Abb. 3: Eine hohe Genauigkeit der Identifizierung von 22 menschlichen Probanden, basierend auf dem halben Gangzyklus, wurde unter Verwendung der Signale erreicht, die erfasst wurden, als die Probanden auf einem Laufband gingen (die Signale werden sowohl in optimalen (oben) als auch in verrauschten (unten) Fällen für zwei verschiedene BMI angezeigt)

Abb. 3: Eine hohe Genauigkeit der Identifizierung von 22 menschlichen Probanden, basierend auf dem halben Gangzyklus, wurde unter Verwendung der Signale erreicht, die erfasst wurden, als die Probanden auf einem Laufband gingen (die Signale werden sowohl in optimalen (oben) als auch in verrauschten (unten) Fällen für zwei verschiedene BMI angezeigt)Die Personenidentifikation ist in vielen Sicherheitsanwendungen eine erforderliche Funktion, z.B. bei der Überwachung des Hauseingangs. Sich nur auf Kamerasysteme zu verlassen, hat schwerwiegende Nachteile bei sehr dunklen oder hellen Lichtverhältnissen sowie bei Vorhandensein von Rauch und/oder Staub, der die Sicht beeinträchtigt. Darüber hinaus sind Kameras auch im Hinblick auf die Wahrung der Privatsphäre von Passanten und Nachbarn problematisch.

Radarsensoren hingegen stehen nicht unter diesen Einschränkungen und können in solchen Anwendungen eingesetzt werden, um für jeden Menschen spezifische Mikrobewegungssignaturen in Echtzeit zu erfassen. In diesem Zusammenhang haben wir eine Studie mit einem tiefen neuronalen Netzwerk durchgeführt, um 22 verschiedene Probanden anhand ihrer Gehsignaturen zu unterscheiden. Es zeigte sich auch eine direkte Korrelation zwischen dem Body-Mass-Index (BMI) und dem Gehstil. Unsere Ergebnisse wurden 2019 auf der IEEE Radar Conference (RadarConf’19) veröffentlicht.

Analyse menschlicher Mikrobewegungen

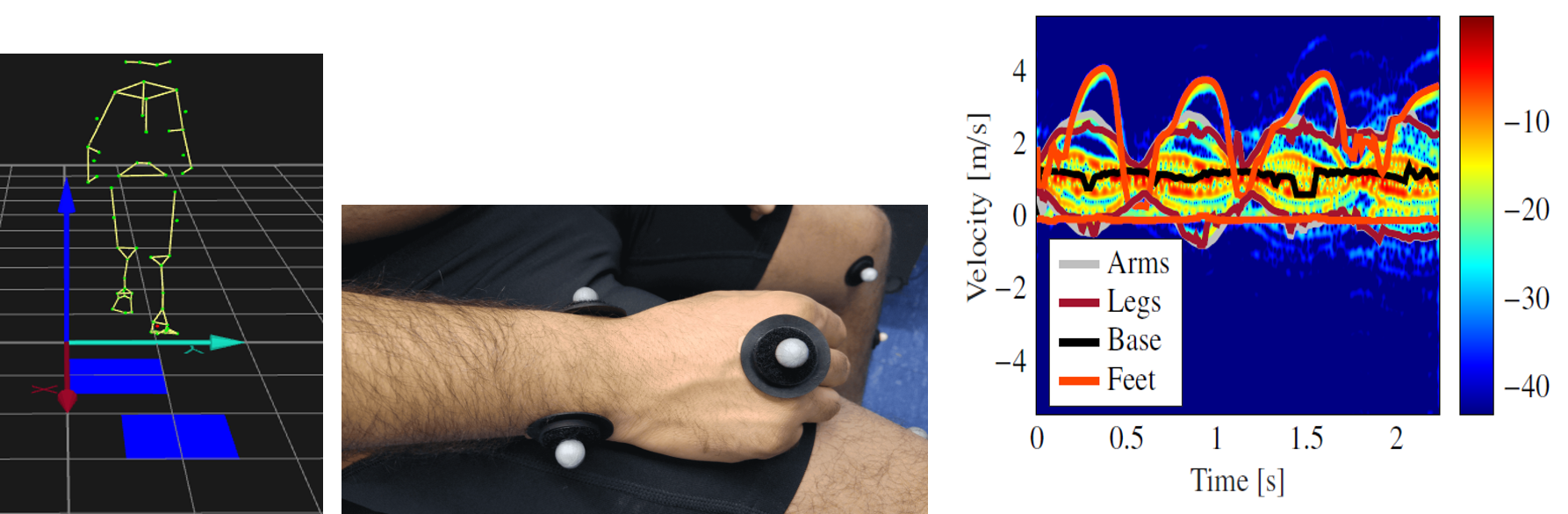

Abb. 4: Schätzung der Bewegungsbahnen menschlicher Gliedmaßen durch Kombination von MoCap-Daten und Radarsignalmodellen

Abb. 4: Schätzung der Bewegungsbahnen menschlicher Gliedmaßen durch Kombination von MoCap-Daten und RadarsignalmodellenDie einzigartige Mikro-Doppler-Signatur (μ-D) der menschlichen Körperbewegung kann als Überlagerung der μ-D-Signaturen der verschiedenen Körperteile analysiert werden. Die Extraktion der μ-D-Signaturen menschlicher Gliedmaßen in Echtzeit kann zur Erkennung, Klassifizierung und Verfolgung menschlicher Bewegungen insbesondere für Sicherheitsanwendungen verwendet werden. Wir haben unser Motion-Capture-System verwendet, um ein realistisches Simulationsmodell der Radarsignale zu entwickeln. Anhand dieses Modells konnten wir die Trajektorien der Gliedmaßen in Echtzeit mithilfe von maschinellem Lernen zerlegen, um vier Hauptklassen (Rumpf - Arme - Beine - Füße) zu unterscheiden. Unsere Ergebnisse wurden 2017 auf der IEEE Radar Conference (RadarConf'17) veröffentlicht.